Trí tuệ nhân tạo đang phát triển nhanh chóng và Microsoft hiện cung cấp Claude của Anthropic dưới dạng mô hình tùy chọn bên trong Microsoft 365 Copilot. Đối với người dùng doanh nghiệp, Claude có nghĩa là bạn có thể chọn nó cho một số nhiệm vụ liên quan đến Phi công phụ với sự cho phép của quản trị viên.

Do đó, bạn có thể tận dụng các điểm mạnh của Claude, như lập luận dài hạn và phản ứng tập trung vào an toàn. Dưới đây là hướng dẫn hướng dẫn bạn cách kích hoạt, quản lý và sử dụng Claude trong Copilot.

Tổng quan nhanh

Sử dụng Claude làm LLM có thể chọn trong Microsoft 365 Copilot và Copilot Studio cho các nhiệm vụ của tổng đài viên và nhà nghiên cứu.

- Các mô hình của Anthropic có thể được lưu trữ bên ngoài môi trường do Microsoft quản lý và có các điều khoản cũng như cách xử lý dữ liệu riêng. Vì vậy, cần có sự đồng ý và nhận thức của quản trị viên.

Trước khi bạn bắt đầu—Danh sách kiểm tra của quản trị viên phải có

- Quyền truy cập của quản trị viên Microsoft 365. Chỉ quản trị viên mới có thể cho phép nhà cung cấp LLM bên thứ ba cho tổ chức.

- Tuân thủ và phê duyệt pháp lý. Các mô hình nhân loại có thể xử lý dữ liệu ngoài tầm kiểm soát trực tiếp của Microsoft. Hơn nữa, hãy xác nhận việc xử lý, lưu giữ dữ liệu và các tác động pháp lý với các nhóm bảo mật hoặc tuân thủ.

- Cấp phép và nhận thức về chi phí. Kiểm tra giấy phép Copilot/Copilot Studio của tổ chức của bạn cũng như mọi chi phí hoặc hạn ngạch bổ sung khi sử dụng mô hình Anthropic.

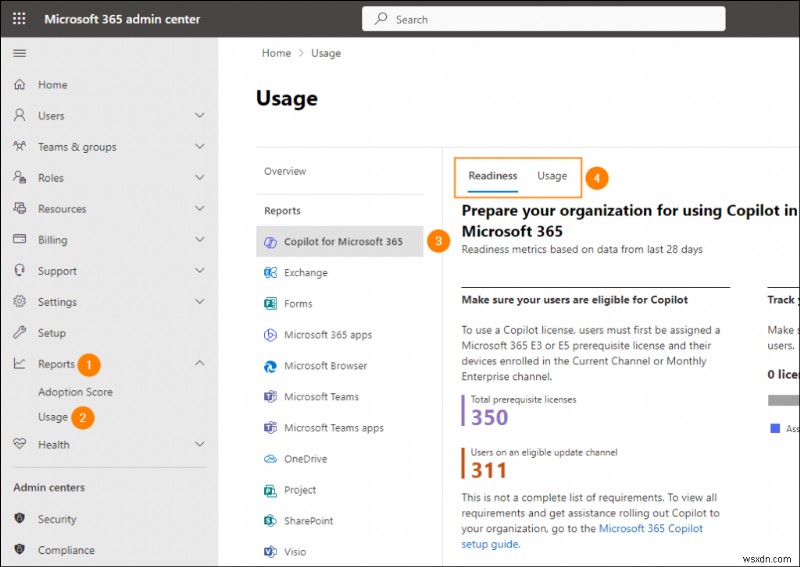

Quản trị viên:Bật Anthropic trong Trung tâm quản trị Microsoft 365

Nguồn Claudecom

Nguồn Claudecom - Đăng nhập vào Trung tâm quản trị Microsoft 365 .

- Đi tới Phi công phụ → Cài đặt → Truy cập dữ liệu (hoặc khu vực “Kết nối với mô hình AI”).

- Dưới Nhà cung cấp LLM cho tổ chức của bạn , định vị Nhân chủng học và cho phép nhà cung cấp. Bạn sẽ cần phải chấp nhận mọi Điều khoản &Điều kiện được hiển thị. Sau khi lưu kết nối, có thể mất vài giờ để hoàn tất.

Tại sao điều này lại quan trọng: cho phép ở cấp độ người thuê là một cổng; bạn sẽ không gặp Claude cho đến khi quản trị viên cho phép.

Định cấu hình quản trị và kiểm soát dữ liệu

- Quyền truy cập phạm vi theo OU hoặc nhóm bảo mật: Hạn chế quyền truy cập của Anthropic vào các nhóm thí điểm (ví dụ:sản phẩm, nghiên cứu) trước khi triển khai đầy đủ.

- Chính sách xử lý dữ liệu: Ghi lại những loại dữ liệu nào được phép (không có PHI/PCI nhạy cảm trừ khi được phép) và liệu nội dung được ghi lại có thể truyền vào môi trường của Anthropic hay không. Tài liệu của Microsoft nêu rõ rằng các mô hình Anthropic được lưu trữ bên ngoài và ghi lại điều đó để kiểm tra.

- Theo dõi nhật ký và đo từ xa: Đảm bảo nhật ký sử dụng Copilot và quy tắc DLP (Ngăn chặn mất dữ liệu) đang hoạt động để bạn có thể theo dõi nội dung nào đã được gửi tới các mô hình bên thứ ba.

Người dùng doanh nghiệp chọn Claude bên trong phi công phụ như thế nào?

Sau khi tổ chức của bạn cho phép bạn và kích hoạt Anthropic:

- Tìm kiếm và mở Microsoft 365 Copilot app hoặc trò chuyện Copilot bên trong các ứng dụng như Word, Excel và Outlook.

- Trong Copilot, chọn Nhà nghiên cứu hoặc chọn Copilot Studio khi bạn đang xây dựng đại lý. Bạn sẽ thấy Hãy thử Claude tùy chọn hoặc có thể chọn các mô hình Sonnet/Opus của Anthropic trong Copilot Studio khi định cấu hình các tùy chọn mô hình. Chọn Thử Claude hoặc mô hình Claude mong muốn.

Mẹo: Trong Researcher, hãy dùng thử Claude, định tuyến lời nhắc của nhân viên và bối cảnh bắt buộc tới mô hình của Anthropic để bạn có thể so sánh kết quả đầu ra với mô hình mặc định của Microsoft.

Quy trình thực tế nên thử trước tiên

- Tóm tắt tài liệu và giao ban: Sử dụng Claude để tóm tắt ngữ cảnh dài, bao gồm các gói cuộc họp và báo cáo dài.

- Nghiên cứu và tìm nguồn cung ứng: Chạy quét tài liệu so sánh hoặc tập hợp các bản tóm tắt nghiên cứu có chú thích thông qua tác nhân Nhà nghiên cứu.

- Thông tin chi tiết về khách hàng: Ngoài ra, hãy phân tích các tập dữ liệu phản hồi lớn, bản chép lại hoặc chủ đề email để tìm hiểu xu hướng.

- Đại lý phi công phụ: Trong Copilot Studio, tạo các tác nhân có nhiệm vụ cụ thể như đánh giá chi phí và trợ giúp giới thiệu. Chọn Claude cho những nhiệm vụ đòi hỏi lý luận cẩn thận hoặc bộ lọc an toàn.

Mẹo nhắc nhở và tương tác dành cho người dùng doanh nghiệp

- Hãy nêu rõ ngữ cảnh: Hơn nữa, nó bao gồm các tài liệu liên quan, phạm vi ngày và định dạng đầu ra mong muốn. Cung cấp bản tóm tắt 3 gạch đầu dòng với các mục hành động.

- Hỏi nguồn: Yêu cầu trích dẫn hoặc dấu vết bằng chứng khi sử dụng Trình nghiên cứu cho công việc thực tế.

- Lặp lại và hạn chế: Đối với một số quy trình công việc nhạy cảm nhất định, hãy giữ lời nhắc trong phạm vi chặt chẽ và tránh dán PII chưa được biên tập.

- So sánh kết quả đầu ra: Ngoài ra, khi chạy thử nghiệm, hãy chạy cùng một lời nhắc đối với mô hình mặc định của Microsoft và Claude để xem mô hình nào hoạt động tốt hơn cho nhiệm vụ của bạn.

Thử nghiệm, đo lường và chia tỷ lệ

- Chạy thí điểm nhỏ (2–4 nhóm) trong hai đến sáu tuần và thu thập phản hồi định tính và định lượng.

- Theo dõi các số liệu như độ chính xác, tỷ lệ xảy ra ảo giác, thời gian tiết kiệm được, điểm tin cậy của người dùng và số lượng sự cố DLP.

- Sử dụng các phát hiện để mở rộng quyền truy cập, tạo mẫu và xây dựng lời nhắc nội bộ cho các tác vụ lặp lại.

Nhắc nhở về bảo mật và tuân thủ

- Mô hình Anthropic có thể xử lý nội dung của tổ chức bạn trong môi trường được lưu trữ trên máy chủ Anthropic. Hơn nữa, việc đảm bảo các nhóm pháp lý và quyền riêng tư phê duyệt việc chuyển giao này.

- Nếu cần, quản trị viên có thể chặn Anthropic sau thông qua cài đặt truy cập dữ liệu tương tự trong trung tâm quản trị đối tượng thuê.

Kết thúc:Tại sao nên thử Claude làm phi công phụ?

Ngoài ra, Claude của Anthropic cung cấp lựa chọn mô hình thay thế trong hệ sinh thái Copilot của Microsoft, cho phép doanh nghiệp của bạn kết hợp điểm mạnh của mô hình với nhiệm vụ.

Do đó, với khả năng quản trị phù hợp, chương trình thí điểm được đo lường và hướng dẫn người dùng rõ ràng, Claude có thể trở thành một sự bổ sung mạnh mẽ cho bộ công cụ Copilot của bạn.

Để biết cách thiết lập quản trị viên và hướng dẫn từng bước chính thức, bạn có thể xem tài liệu quản trị viên Copilot của Microsoft và các bài đăng thông báo của Anthropic.