Khi mọi người nghĩ về trí tuệ nhân tạo, họ tưởng tượng đến các mô hình, trung tâm dữ liệu và máy chủ đám mây phức tạp.

Điều mà hầu hết mọi người không nhận ra là động cơ thực sự đằng sau cuộc cách mạng AI này bắt đầu ở một nơi mà ít ai ngờ tới:bên trong chiếc PC chơi game khiêm tốn.

Các card đồ họa tương tự từng được chế tạo để hiển thị hình ảnh 3D mượt mà hiện đang cung cấp năng lượng cho chatbot, trình tạo hình ảnh và hệ thống tự lái. Hành trình từ pixel đến dự đoán là một trong những câu chuyện hấp dẫn nhất trong điện toán hiện đại.

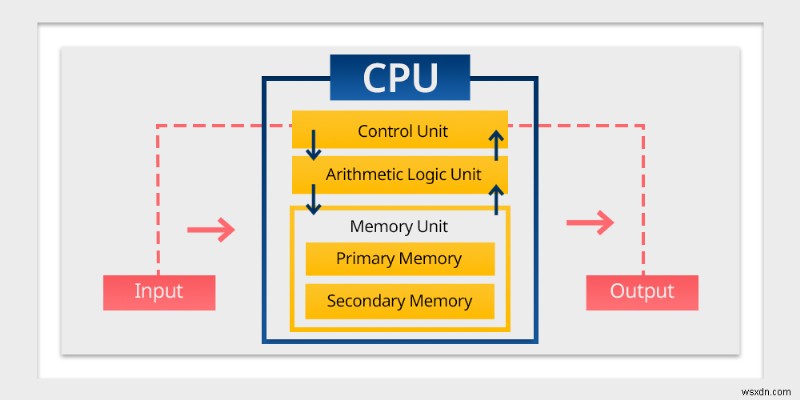

Kỷ nguyên CPU và những giới hạn của nó

Trong những ngày đầu của học máy, các nhà nghiên cứu phụ thuộc vào CPU để xử lý dữ liệu.

CPU rất linh hoạt và tuyệt vời để xử lý nhiều tác vụ khác nhau, nhưng chúng có một hạn chế lớn:chúng xử lý các vấn đề theo trình tự.

Điều đó có nghĩa là họ chỉ có thể xử lý một vài thao tác cùng một lúc. Đối với các mô hình nhỏ, điều này là tốt. Nhưng khi mạng lưới thần kinh ngày càng phức tạp, việc đào tạo chúng trên CPU trở nên chậm chạp.

Hãy tưởng tượng bạn đang cố gắng dạy một máy tính nhận dạng hình ảnh. Mạng lưới thần kinh có thể có hàng triệu tham số và mỗi tham số cần được điều chỉnh nhiều lần trong quá trình đào tạo.

Trên CPU, việc đó có thể mất vài ngày hoặc thậm chí vài tuần. Các nhà nghiên cứu nhanh chóng nhận ra rằng nếu AI muốn phát triển thì nó cần một loại phần cứng hoàn toàn khác.

GPU xuất hiện như thế nào

Các bộ xử lý đồ họa hay GPU ban đầu được xây dựng để hiển thị hình ảnh chuyển động nhanh trong trò chơi điện tử. Chúng được thiết kế để thực hiện song song, thực hiện hàng nghìn phép tính nhỏ cùng lúc.

Trong khi CPU có thể có một số lõi thì GPU có hàng nghìn lõi. Kiến trúc này khiến GPU trở nên lý tưởng cho loại toán học được sử dụng trong học máy, trong đó thao tác tương tự cần được áp dụng đồng thời cho lượng dữ liệu khổng lồ.

Theo một cách nào đó, GPU được tạo ra cho trò chơi nhưng lại dành cho AI. Khởi đầu là một con chip giúp hiệu ứng ánh sáng mượt mà hơn và các vụ nổ trông thực tế hơn, đã sớm tìm ra mạng lưới thần kinh cung cấp năng lượng cho mạng lưới thần kinh thứ hai.

Khoảng đầu những năm 2010, các nhà nghiên cứu bắt đầu thử nghiệm chạy thuật toán học sâu trên GPU và kết quả thật đáng kinh ngạc. Thời gian huấn luyện giảm từ vài tuần xuống còn vài ngày và độ chính xác được cải thiện.

Đó là một cuộc cách mạng thầm lặng diễn ra trong các phòng thí nghiệm nghiên cứu trên khắp thế giới.

Vai trò của PC chơi game trong nghiên cứu AI ban đầu

Đây là lúc câu chuyện trở nên thú vị hơn:nhiều đột phá ban đầu trong AI không đến từ các trung tâm dữ liệu khổng lồ hay siêu máy tính đắt tiền. Chúng đến từ các nhà nghiên cứu sử dụng GPU cấp độ người tiêu dùng, thường nằm trong PC chơi game thông thường.

Những cỗ máy này, được thiết kế để giải trí, hóa ra lại đủ mạnh cho các thí nghiệm học sâu.

Nền tảng CUDA của NVIDIA đã biến điều này thành hiện thực bằng cách cho phép các nhà phát triển lập trình GPU cho các tác vụ ngoài đồ họa. Đột nhiên, GPU chơi game có thể xử lý các phép tính khoa học phức tạp.

Các nhà nghiên cứu đã sử dụng thiết bị của riêng họ, đôi khi là chính những máy tính mà họ dùng để chơi game vào ban đêm, để huấn luyện mạng lưới thần kinh nhận dạng giọng nói, hình ảnh và văn bản. Máy tính chơi game đã trở thành nơi thử nghiệm tương lai của trí tuệ nhân tạo.

Bước ngoặt:AlexNet và sự bùng nổ về học tập sâu

Vào năm 2012, mạng lưới thần kinh có tên AlexNet đã khiến cả thế giới choáng váng khi giành chiến thắng trong cuộc thi ImageNet, một chuẩn mực chính về thị giác máy tính.

Điều khiến AlexNet trở nên đặc biệt không chỉ là kiến trúc mà còn là phần cứng đằng sau nó. Nó chạy trên hai GPU NVIDIA GTX 580, phần cứng mà bạn có thể mua cho PC chơi game giá rẻ của mình. Trận thắng đó đánh dấu một bước ngoặt. Nó chứng minh rằng GPU không chỉ dùng để kết xuất đồ họa mà còn là chìa khóa để phát triển AI.

Sau đó, thế giới AI thay đổi nhanh chóng. Mọi phòng thí nghiệm nghiên cứu và công ty công nghệ lớn đều bắt đầu xây dựng các cụm GPU. NVIDIA, nhận thấy cơ hội, đã chuyển sang phát triển phần cứng AI.

Cùng một công ty từng phục vụ chủ yếu cho các game thủ giờ đây đã cung cấp cho Google, OpenAI và Tesla. Những gì ban đầu là một công cụ mang lại hình ảnh đẹp hơn đã trở thành xương sống của trí tuệ máy móc.

Tại sao GPU lại có khả năng xử lý AI tốt đến vậy

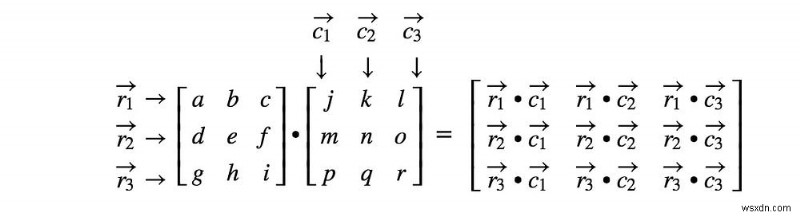

GPU vượt trội ở môn toán ma trận, loại tính toán mà mạng lưới thần kinh dựa vào.

Khi huấn luyện một mô hình, bạn liên tục nhân và cộng các ma trận số. GPU thực hiện việc này nhanh hơn vì chúng xử lý song song hàng nghìn thao tác. Chúng cũng được thiết kế với băng thông bộ nhớ cao, nghĩa là chúng có thể di chuyển lượng lớn dữ liệu vào và ra một cách nhanh chóng.

Kiến trúc này hoàn toàn phù hợp với khối lượng công việc deep learning. Cho dù đó là nhận dạng hình ảnh hay dịch ngôn ngữ, GPU đều có thể xử lý hàng loạt dữ liệu khổng lồ cùng một lúc.

Ngược lại, CPU bị tắc nghẽn do xử lý tuần tự. Sự khác biệt về hiệu suất giống như so sánh một người thợ thủ công đang xây một ngôi nhà với một nhóm hàng ngàn người làm việc cùng một lúc.

Cuộc đua phần cứng AI

Khi AI cất cánh, nhu cầu về GPU bùng nổ. Những gì bắt đầu từ máy tính chơi game đã mở rộng quy mô thành các trung tâm dữ liệu khổng lồ chứa hàng nghìn thẻ.

Các công ty như NVIDIA đã phát triển các dòng GPU mới dành riêng cho AI, chẳng hạn như dòng Tesla và A100. Những đối thủ khác cũng tham gia cuộc đua, như AMD với nền tảng ROCm và Google với TPU (Bộ xử lý Tensor) tùy chỉnh.

Tuy nhiên, ngay cả ngày nay, ranh giới giữa chơi game và phần cứng AI vẫn còn mờ nhạt. Các GPU RTX tương tự được thiết kế cho game thủ vẫn được nhiều nhà nghiên cứu AI và các công ty khởi nghiệp nhỏ sử dụng.

Một PC chơi game mạnh mẽ được trang bị GPU hiện đại có thể chạy các mô hình AI cục bộ, tạo hình ảnh hoặc thậm chí tinh chỉnh các mô hình ngôn ngữ nhỏ. Phần cứng giúp thế giới ảo trở nên sống động giờ đây mang trí thông minh đến thế giới thực của chúng ta.

Tương lai của GPU và AI

Khi các mô hình AI phát triển lớn hơn, những thách thức mới đang xuất hiện. GPU đang phát triển để xử lý các mô hình nghìn tỷ thông số, nhưng chúng cũng ngày càng thông minh hơn về việc sử dụng năng lượng và hiệu quả.

Các công nghệ như thiết kế chiplet, kết nối quang học và lõi dành riêng cho AI đang nâng cao hiệu suất hơn nữa trong khi vẫn giảm chi phí.

Trong khi đó, AI địa phương đang quay trở lại. Với những tiến bộ về hiệu suất GPU, nhiều người dùng đang thử nghiệm các mô hình chạy trên máy của chính họ.

Giờ đây, một PC chơi game được trang bị tốt có thể thực hiện những việc từng yêu cầu quyền truy cập vào cụm GPU đám mây. Sự thay đổi này có thể dân chủ hóa việc phát triển AI, cho phép bất cứ ai có phần cứng phù hợp khám phá lĩnh vực này ngay tại nhà.

Kết luận

Hành trình của GPU từ chơi game đến AI là một trong những bước chuyển đổi bất ngờ nhất trong lịch sử công nghệ. Khởi đầu là một con chip hiển thị cảnh quan ảo đã phát triển thành trung tâm của trí tuệ nhân tạo. Từ những thử nghiệm ban đầu trên máy tính chơi game cho đến các trung tâm dữ liệu cung cấp năng lượng cho các mẫu máy lớn nhất hiện nay, GPU đã kết nối thế giới sáng tạo, tính toán và nhận thức.

Khi chúng ta nhìn về phía trước, rõ ràng là công nghệ từng làm cho trò chơi trở nên thực tế hơn giờ đây đang làm cho máy móc trở nên thông minh hơn. Câu chuyện về GPU nhắc nhở chúng ta rằng sự đổi mới thường đến từ những nơi không ngờ tới và đôi khi, tương lai của AI bắt đầu từ ánh sáng rực rỡ của màn hình chơi game.

Hy vọng bạn thích bài viết này. Tìm tôi trên Linkedin hoặc truy cập trang web của tôi .

Học cách viết mã miễn phí. Chương trình giảng dạy mã nguồn mở của freeCodeCamp đã giúp hơn 40.000 người có được việc làm với tư cách là nhà phát triển. Bắt đầu