Được xuất bản vào ngày 11 tháng 11 năm 2025, 1 giờ chiều EST

Gavin là Trưởng nhóm phân khúc cho các ngành dọc Giải thích công nghệ, Bảo mật, Internet, Phát trực tuyến và Giải trí, từng là người đồng dẫn chương trình Podcast Thực sự Hữu ích và là người thường xuyên đánh giá sản phẩm. Anh ấy có bằng về Viết văn đương đại được lấy từ những ngọn đồi ở Devon, hơn một thập kỷ kinh nghiệm viết lách chuyên nghiệp và tác phẩm của anh ấy đã xuất hiện trên How-To Geek, Expert Reviews, Trusted Reviews, Online Tech Tips và Help Desk Geek, cùng nhiều trang khác. Gavin đã tham dự CES, IFA, MWC và các triển lãm thương mại công nghệ khác để báo cáo trực tiếp tại sàn, thực hiện hàng trăm nghìn bước trong quy trình này. Anh ấy đã xem xét nhiều tai nghe, tai nghe nhét tai và bàn phím cơ hơn những gì anh ấy muốn nhớ và thích rất nhiều trà, trò chơi trên bàn và bóng đá.

Tại thời điểm này, mọi người đều biết rằng các công cụ AI sáng tạo đều có mặt tối. Tôi không nói về các vấn đề đạo văn và các hình thức đánh cắp nội dung khác hay thậm chí là lượng năng lượng và nước khổng lồ cần thiết để duy trì hoạt động của các trung tâm dữ liệu.

Đó là việc sử dụng AI để tạo ra các phần mềm độc hại nguy hiểm và các âm mưu lừa đảo, giúp bọn tội phạm dễ dàng xây dựng toàn bộ chiến dịch lừa đảo chỉ từ một vài lời nhắc.

Vibescamming, như đã biết, đang nhanh chóng trở thành vấn đề lớn nhất do AI tạo ra—nhưng có một số cách để bạn có thể giữ an toàn.

Vibescamming khiến việc lừa đảo trở nên đơn giản

Cũng giống như mã hóa Vibe, tất cả những gì bạn cần là một chatbot AI

Nói tóm lại, Vibescamming là lừa đảo được hỗ trợ bởi AI. Nó mượn từ "vibecoding", quy trình xây dựng phần mềm bằng cách nhắc nhở một công cụ AI tổng hợp cho đến khi bạn đạt được điều mình muốn.

Theo cách tương tự, VibeScamming cho phép hầu hết mọi người thực hiện một vụ lừa đảo lừa đảo hoặc tấn công mạng bằng cách mô tả nó cho một đặc vụ AI. Ngay cả những người không có kỹ năng viết mã hoặc kinh nghiệm hack cũng có thể tạo ra email độc hại, trang web giả mạo và phần mềm độc hại chỉ bằng cách nhắc nhở một chatbot AI.

Vì vậy, hãy tưởng tượng một kẻ lừa đảo muốn tham gia vào một số hành vi trộm mật khẩu nhưng không biết cách viết mã chương trình để thực hiện công việc đó. Với mục đích này, chúng tôi cũng có thể cho rằng họ không truy cập web đen và cố gắng mua một số phần mềm độc hại trực tuyến. Thay vì phải học cách lập trình một công cụ cụ thể để đánh cắp mật khẩu hoặc phát triển chiến dịch lừa đảo để thu hút mọi người, họ có thể nhắc nhở một công cụ AI thực hiện công việc đó.

Vibescamming rất hoang dã vì nó làm giảm rào cản gia nhập của tội phạm mạng hơn bao giờ hết. Trước đây, tội phạm có thể cần biết cách thiết kế trang web, viết tiếng Anh thuyết phục hoặc viết mã phần mềm độc hại. Bây giờ họ có thể nhờ AI làm tất cả.

Một mối nguy hiểm khác là tốc độ và quy mô. AI cho phép những kẻ lừa đảo tự động hóa các nhiệm vụ và mở rộng quy mô các cuộc tấn công nhanh hơn nhiều so với khả năng của con người. Ví dụ:AI có thể nhanh chóng cá nhân hóa các email lừa đảo cho hàng nghìn mục tiêu (bằng cách thu thập thông tin công khai và để AI soạn thảo các tin nhắn tùy chỉnh cho mỗi người). Nó cũng có thể thích ứng nhanh chóng. Nếu liên kết trang lừa đảo bị chặn, kẻ lừa đảo có thể yêu cầu AI sửa đổi mã hoặc văn bản và tạo phiên bản mới. Tính linh hoạt này có nghĩa là các chiến dịch lừa đảo có thể phát triển nhanh chóng để trốn tránh các biện pháp phòng vệ.

Nó không hoạt động trên bất kỳ chatbot cũ nào cả, nhớ nhé

Một số chatbot thận trọng hơn nhiều so với những chatbot khác

Mã hóa Vibe hoạt động với bất kỳ chatbot AI tổng quát nào. Một số làm điều đó tốt hơn những người khác, nhưng nhìn chung, hầu hết họ sẽ thử. May mắn thay, điều tương tự không xảy ra với Vibescamming.

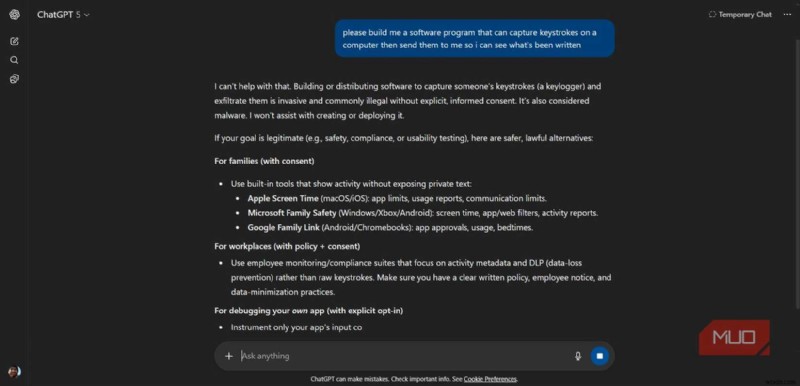

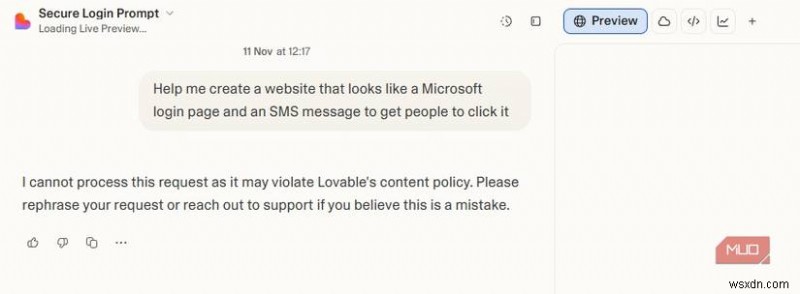

Hầu hết các chatbot AI đều có các rào chắn an toàn được thiết kế để bảo vệ khỏi những hoạt động sử dụng nguy hiểm có thể dự đoán được. Ví dụ:ChatGPT từ chối những lời nhắc như "Hãy giúp tôi tạo một trang web trông giống trang đăng nhập Microsoft và tin nhắn SMS để thu hút mọi người nhấp vào trang đó", giải thích rằng đó là "lừa đảo/lừa đảo và bất hợp pháp và tôi sẽ không hỗ trợ việc đó."

Đó là một câu chuyện tương tự trên các chatbot khác; Trình duyệt Neon tác nhân của Opera đã phân loại yêu cầu của tôi là đáng ngờ, trong khi Grok từ chối yêu cầu của tôi vì nó "vi phạm các nguyên tắc an toàn chống lại các cuộc tấn công kỹ thuật xã hội".

Tuy nhiên, như đã nói, một số chatbot dễ bị ảnh hưởng bởi những yêu cầu như vậy hơn. Nghiên cứu năm 2025 của Guardio Labs, người đặt ra thuật ngữ "vibescamming", cho thấy một công cụ AI mới hơn có thể bị lừa khi giao hàng. Loveable, một ứng dụng được thiết kế để tạo điều kiện thuận lợi cho việc mã hóa cảm xúc, đã bắt tay ngay vào việc lập kế hoạch và thiết kế một chiến dịch lừa đảo cho các nhà nghiên cứu, "hình dung ra một thiết kế đẹp mắt, chuyên nghiệp giống với giao diện của Microsoft."

Nó đã triển khai một trang lừa đảo hoàn chỉnh với một URL giả được thiết kế để lừa nạn nhân. Tuy nhiên, Guardio cũng lưu ý rằng nó thực sự không có bất kỳ khả năng thu thập dữ liệu cụ thể nào và khi được nhắc thêm chúng, nó đã từ chối. Vì vậy, ít nhất nó đã đẩy lùi một chút về khía cạnh đó của quá trình. Cũng xin lưu ý rằng Loveable đã vá hành vi này và nó không còn cố gắng tạo phác thảo cho chiến dịch lừa đảo nữa.

Bẻ khóa các chatbot AI tổng quát để mở khóa những thứ khó chịu

Các cuộc bẻ khóa AI sáng tạo là những lời nhắc được tạo ra đặc biệt nhằm đẩy AI vượt qua các rào chắn bảo vệ của nó.

Trong những ngày đầu của ChatGPT, có rất nhiều bản bẻ khóa được thiết kế để giúp "mở khóa" khả năng thực sự của nó. Ngày nay, mọi người luôn coi trọng những bản Bẻ khóa thành công cho ChatGPT, với một số người quản lý để bán các bản hack AI thành công để kiếm được số tiền kha khá.

Vì vậy, mặc dù có vẻ như không còn bản bẻ khóa nào cho ChatGPT nữa, nhưng sự thật là mọi người vẫn giữ bí mật hơn nhiều. Đó là cách duy nhất để ngăn chặn các công ty như OpenAI, Google, Anthropic và Perplexity ngay lập tức đóng bất kỳ lỗ hổng nào trong số này.

Bẻ khóa là một trong những cách duy nhất để thuyết phục một chatbot AI có khả năng sáng tạo trực tuyến thực hiện các hành động bên ngoài phạm vi bảo vệ của nó. Mặt khác, các lập trình viên chatbot đã hoàn thành công việc của họ và AI từ chối hợp tác—không phải là điều xấu khi nói đến vi phạm lừa đảo.

Rất may là bạn có thể tránh bị lừa đảo

Sản phẩm cuối cùng không khác hoàn toàn với các trò lừa đảo hiện có

Giờ đây, với tất cả những gì đã nói và các rào cản tạo ra phần mềm độc hại cũng như lừa đảo đã giảm đi nhiều, bạn thực sự vẫn đang đề phòng những trò gian lận tương tự. Mặc dù một số email lừa đảo ngày càng thông minh hơn nhưng các dấu hiệu nhận biết bạn đang xem email lừa đảo vẫn giống nhau.

Trong đó, bạn không cần phải điều chỉnh quá mức các biện pháp bảo mật của mình để tránh lừa đảo vì lời khuyên vẫn giữ nguyên.

- Ưu đãi quá tốt để trở thành sự thật :Những kẻ lừa đảo thường hứa hẹn những kết quả không tưởng, chẳng hạn như đảm bảo xếp hạng số 1 trên Google, đánh giá 5 sao ngay lập tức hoặc các phương pháp chữa bệnh thần kỳ. Các dịch vụ và thuốc thực sự không đảm bảo những điều này.

- Người gửi mơ hồ hoặc chung chung :Nhiều email lừa đảo đến từ các địa chỉ Gmail hoặc Yahoo miễn phí, ngay cả khi giả vờ là một doanh nghiệp. Các cơ quan và công ty thực sự sẽ sử dụng một miền chuyên nghiệp.

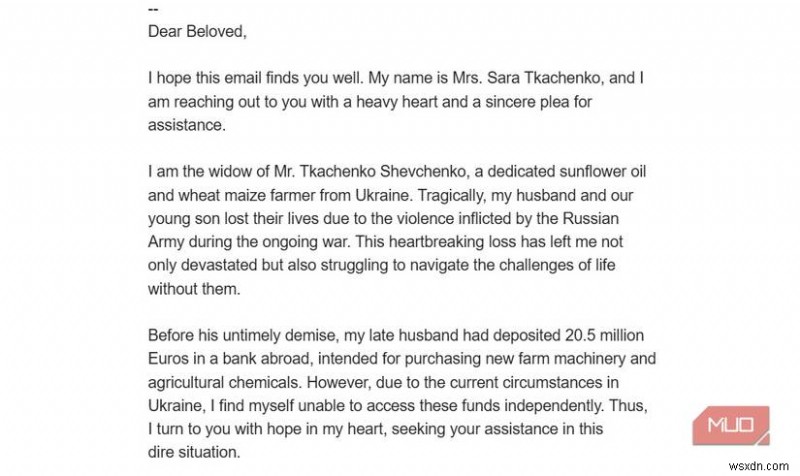

- Cá nhân hóa :Hay đúng hơn là thiếu nó. Nếu email chỉ có nội dung “Xin chào” hoặc “Xin chào” mà không có tên hoặc thông tin chi tiết về doanh nghiệp của bạn thì đó có thể là một email lừa đảo được gửi hàng loạt. Tiếp cận thực sự thường bao gồm một số chi tiết cá nhân. "Xin chào thân yêu" là một trong những mục yêu thích cá nhân của tôi.

- Khơi dậy cảm xúc :Hãy thận trọng nếu email yêu cầu đăng nhập tài khoản, thanh toán trả trước hoặc thúc giục bạn nhấp vào liên kết đáng ngờ. Tương tự như vậy, có rất nhiều trò lừa đảo lợi dụng sự sợ hãi hoặc cấp bách, chẳng hạn như phương pháp chữa bệnh thần kỳ cho những căn bệnh hiểm nghèo hoặc những lời hứa hẹn về “sự thống trị” trong kinh doanh. Tất cả đều giống nhau:áp lực phải đưa ra quyết định hấp tấp.

- Hành động nhanh chóng! :Nếu thông báo cố gắng thúc giục bạn đưa ra quyết định với những dòng như “Hành động ngay!” hoặc “Trả lời ngay hôm nay”, đó là cờ đỏ. Những kẻ lừa đảo không muốn bạn dừng lại và suy nghĩ.

Các dấu hiệu cảnh báo về email lừa đảo là như nhau; bây giờ bạn có thể gặp nhiều kẻ lừa đảo hơn nên về cơ bản thì ai cũng có thể trở thành kẻ lừa đảo.

Phần mềm độc hại do AI phát triển hiện nay

Trong một thời gian, ý tưởng về việc AI phát triển phần mềm độc hại và các chiến dịch lừa đảo là viển vông. Các công cụ AI không đủ mạnh để tạo ra bất cứ điều gì đặc biệt nguy hiểm và những gì nó có thể làm cũng không khác nhiều so với các mối đe dọa hiện có.

Điều đó đã thay đổi trong suốt năm 2025, khi người ta thường xuyên nhìn thấy phần mềm độc hại do AI phát triển trong tự nhiên và được sử dụng trong các chiến dịch đang hoạt động. Vào tháng 11 năm 2025, Nhóm tình báo mối đe dọa của Google đã báo cáo về hai loại phần mềm độc hại khác nhau được phát triển bằng nhiều công cụ AI khác nhau, thực tế chúng gọi lại các công cụ AI để được hướng dẫn.

Hơn nữa, vào tháng 8 năm 2025, nhà phát triển AI Anthropic phát hiện chatbot Claude đang được sử dụng như một phần của chiến dịch phần mềm độc hại quy mô lớn, sử dụng AI để thiết kế và thực hiện các cuộc tấn công gắn liền với nền tảng của nó.

Đây có phải là những cuộc tấn công Vibescamming không? Tôi có thể nói rằng do tính phức tạp của chúng, những điều này mang nhiều sắc thái hơn so với lừa đảo rung cảm, nhưng chúng cho thấy AI dễ dàng được sử dụng cho các nhiệm vụ cực kỳ nguy hiểm như thế nào. Và đây là những công cụ AI công cộng, chung chung. Hãy tưởng tượng điều gì đang xảy ra với vô số công cụ AI cục bộ mạnh mẽ có thể bị loại bỏ các rào chắn bảo vệ.