Được xuất bản vào ngày 30 tháng 4 năm 2026, 3:30 chiều EDT

Kinh nghiệm của Afam trong lĩnh vực xuất bản công nghệ bắt đầu từ năm 2018, khi anh làm việc cho Make Tech Easier. Trong những năm qua, ông đã tạo dựng được danh tiếng nhờ xuất bản các bài viết hướng dẫn, đánh giá, thủ thuật và giải thích chất lượng cao, bao gồm Windows, Linux và các công cụ nguồn mở. Tác phẩm của anh đã được giới thiệu trên các trang web hàng đầu, bao gồm cả Digital Ustad, Windows Report, Guiding Tech, Alphr và Next of Windows.

Anh có bằng đầu tiên về Khoa học Máy tính và là người ủng hộ mạnh mẽ quyền riêng tư và bảo mật dữ liệu, với một số mẹo, video và hướng dẫn về chủ đề này được đăng trên kênh YouTube Fuzo Tech.

Khi không làm việc, anh ấy thích dành thời gian cho gia đình, đạp xe hoặc chăm sóc khu vườn của mình.

Tôi chưa bao giờ nghĩ việc chạy LLM cục bộ trên Windows lại khó khăn đến vậy. Ngay cả khi mọi thứ có vẻ ổn nhưng sau đó tôi nhận ra rằng phiên bản đó đang chạy hoàn toàn trên CPU của tôi. Định cấu hình trình điều khiển, biến môi trường và cuối cùng là thiết lập WSL2 sau khi lấy mô hình Ollama giống như một dự án riêng biệt. Và sau đó, tôi thấy việc duy trì stack rất mệt mỏi.

Tôi rất ngạc nhiên khi dùng thử nó trên Linux. Quá trình này trực tiếp hơn, dễ dàng hơn và thành thật mà nói, tôi không còn mong đợi mọi thứ sẽ đổ vỡ nữa. Cảm giác này tương tự như khi tôi biến thiết bị đầu cuối Linux của mình thành trợ lý AI cục bộ.

Quá trình thiết lập lẽ ra phải mất mười phút

Tại sao Ollama trên Windows cứ kéo bạn lại

Quá trình thiết lập Ollama trên Windows có vẻ đơn giản nhưng trên thực tế, nó vượt xa việc tải xuống và chạy trình cài đặt. Trong lần chạy đầu tiên, bạn có thể bị thuyết phục rằng mọi thứ đều hoàn hảo vì bạn sẽ nhận được tin nhắn và phản hồi. Tuy nhiên, kiểm tra bằng lệnh:ollama ps , cho thấy một GPU nhàn rỗi. Điều này là do nó chạy trên CPU và chỉ 3 đến 5 mã thông báo mỗi giây là chậm hơn đáng kể so với mức cần thiết.

Dự phòng im lặng mặc định của Ollama rất phổ biến và khó phát hiện vì nó không phát ra lỗi. Hành vi này có thể xảy ra trên các hệ điều hành khác nếu VRAM khả dụng quá nhỏ so với kiểu máy. Tuy nhiên, trên Windows, một số yếu tố khác, chẳng hạn như điều kiện chạy đua của trình điều khiển/trình cài đặt, sự lan truyền của biến môi trường và việc sử dụng tài nguyên cạnh tranh, có thể kích hoạt nó.

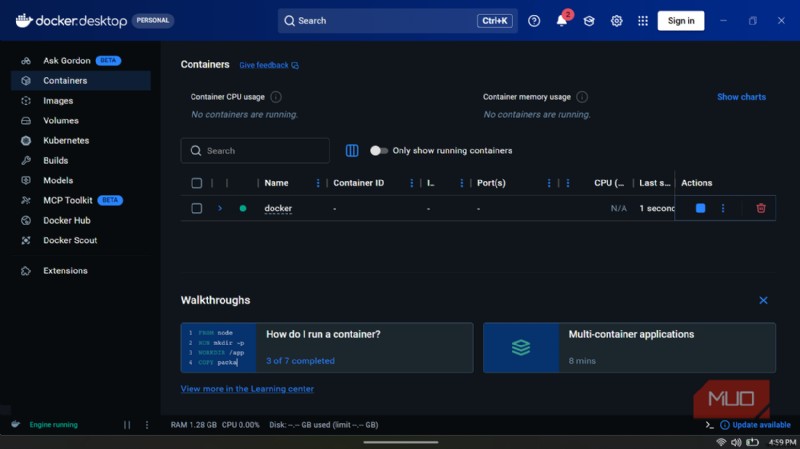

Ngay cả khi không có gì có vẻ lạc lõng, nó vẫn có thể thất bại; trong những trường hợp đó, bạn có thể chuyển sang WSL2. Tôi đã thử Open WebUI qua Docker, điều này khiến Ollama có cảm giác giống như một ChatGPT cục bộ mặc dù đây là một dịch vụ dựa trên trình duyệt. Tuy nhiên, Docker chạy đáng tin cậy nhất trên Windows từ WSL2. Đây là môi trường Linux chạy trong Windows và bạn phải định cấu hình nó cẩn thận để tránh mọi rắc rối.

Tất nhiên, cuối cùng bạn sẽ hoàn thành tốt công việc đó. Tuy nhiên, vấn đề nhỏ là quá trình này không bao giờ có cảm giác như nó đã thực sự kết thúc. Đó là một chu kỳ sửa chữa thứ này, thứ khác, rồi thứ khác. Bạn không bao giờ có thể dự đoán được sẽ mất bao lâu để thiết lập hoạt động; có thể là năm phút hoặc năm giờ.

Liên quan

Liên quan

5 lệnh terminal Linux khắc phục hầu hết các sự cố hệ thống của tôi

Các lệnh khắc phục sự cố Linux cơ bản mà mọi người dùng nên biết.

Quá trình cài đặt Linux thực sự trông như thế nào

Một lệnh, GPU hoạt động và không còn gì để định cấu hình

So sánh, việc cài đặt LLM cục bộ trên Linux là không có vấn đề gì. Tôi đã chuyển từ một lệnh cài đặt sang tải xuống mô hình, đã phát hiện thấy GPU và thế là xong. Khi tôi tạo phản hồi đầu tiên, tôi đã chờ đợi trong trường hợp có điều gì đó cần khắc phục; không hề có.

Đây không phải là câu hỏi hệ điều hành nào tốt hơn. Đơn giản là thực tế là tập lệnh cài đặt cho Ollama lần đầu tiên được viết cho Linux và hoạt động gần như hoàn hảo, từ cài đặt các tệp nhị phân và đăng ký Ollama làm dịch vụ nền khởi động cùng hệ thống, đến tự động phát hiện phần cứng GPU. Không có điều nào trong số này yêu cầu lớp cầu nối hoặc dịch môi trường. Miễn là tất cả các trình điều khiển đều có sẵn trước khi cài đặt thì toàn bộ quá trình sẽ tự diễn ra.

Nếu việc phát hiện GPU không thành công do bạn đã cài đặt trước khi trình điều khiển được xác nhận, bạn chỉ cần cài đặt lại Ollama để khắc phục.

Theo kinh nghiệm của tôi, đây là cách so sánh quy trình trên cả hai hệ điều hành:

<đầu>Bước

Windows

Linux

Cài đặt Ollama

Trình cài đặt .exe (việc sử dụng GPU yêu cầu xác minh riêng)

Một lệnh (GPU được phát hiện tự động)

GPU thực sự được sử dụng trong lần chạy đầu tiên

Thường quay trở lại CPU một cách âm thầm

Sử dụng ngay nếu có driver

Mở thiết lập WebUI

Cần cài đặt WSL2 và cấu hình Docker bên trong nó

Lệnh Docker đơn

Tăng tốc GPU AMD

Thử nghiệm (ROCm v6.1+, báo cáo dự phòng CPU thường xuyên)

Hỗ trợ đầy đủ qua ROCm v7

Ollama chạy khi khởi động

Yêu cầu cấu hình thủ công

Tự động qua systemd

Windows được hỗ trợ — Linux là nơi chúng được viết ra

Khi bạn ở trong hệ sinh thái đủ lâu, bạn sẽ phát hiện ra rằng Ollama, Open WebUI và Docker không được xây dựng cho Windows cũng như không tích hợp Python được xây dựng xung quanh chúng. Sự hỗ trợ của Windows được đặt lên hàng đầu và điều này tạo ra sự khác biệt đáng kể.

Ví dụ điển hình nhất là Open WebUI, đây là một lệnh Docker duy nhất trên Linux. Lệnh này sẽ ngay lập tức khởi động vùng chứa kết nối với phiên bản cục bộ của Ollama trong khi bạn mở trình duyệt. Trên Windows, bạn đang cấu hình tất cả các phần tử này. Nó hoạt động nhưng thường thì nó không hoạt động trong lần thử đầu tiên của bạn, điều này thường dẫn đến quá trình gỡ lỗi mất nhiều thời gian.

Những vấn đề này thậm chí còn phức tạp hơn đối với người dùng GPU AMD. Có sự hỗ trợ đầy đủ của Linux cho ROCm phiên bản 7, nền tảng điện toán của AMD dành cho suy luận GPU. Trên Windows, hỗ trợ chính thức dừng ở phiên bản 6.1+ và vẫn mang tính thử nghiệm. Do đó, nhiều người dùng Windows sử dụng GPU AMD vẫn chạy Ollama trên CPU, bất kể khả năng phần cứng của họ như thế nào. Ngăn xếp GPU cơ bản không có sẵn.

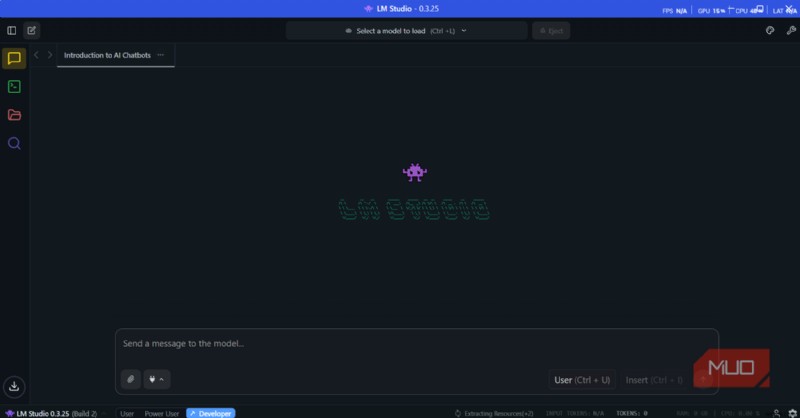

Hãy cân nhắc sử dụng LM Studio như một công cụ riêng biệt với Ollama. Đó là GUI đầu tiên, chạy sạch trên Windows và Linux và cho phép bạn chạy các mô hình mà không cần thiết bị đầu cuối. Tuy nhiên, nó chỉ hoạt động nếu bạn muốn trò chuyện với LLM địa phương mà không cần làm gì thêm.

Thời gian bạn tiết kiệm không được trả trước

Mặc dù tôi thấy quá trình cài đặt ban đầu rất trôi chảy nhưng tôi đánh giá cao cách LLM cục bộ hoạt động trên Linux nhiều hơn với mỗi lần sử dụng thiết lập tiếp theo của tôi. Lý do là vì đây không phải là bản cài đặt một lần mà bạn có thể sử dụng mãi mãi. Bạn tiếp tục thử các mẫu mới hơn khi chúng có sẵn. Bạn liên tục thử các phiên bản nhỏ hơn, lượng tử hóa khi mô hình trở nên quá chậm.

Tất cả đều yêu cầu thay đổi cấp hệ thống. Những rắc rối ban đầu trên Windows có thể tái diễn khi bạn thực hiện thay đổi và sẽ chỉ khiến trải nghiệm của bạn với LLM cục bộ trở nên rất khó chịu.

Nếu bạn đang muốn dùng thử Linux chỉ vì LLM cục bộ, tôi khuyên bạn nên sử dụng Linux Mint. Đây có lẽ là bản phân phối tốt nhất cho bất kỳ ai đến từ hệ sinh thái Windows.

HĐH Linux

Thông số CPU tối thiểu Lõi đơn 64-bit

Thông số RAM tối thiểu 1,5GB

Linux Mint là một hệ điều hành mã nguồn mở, miễn phí và phổ biến dành cho máy tính để bàn và máy tính xách tay. Nó thân thiện với người dùng, ổn định và có nhiều chức năng ngay lập tức.