Toàn bộ câu chuyện này bắt đầu bằng một bài báo được xuất bản bởi các nhà nghiên cứu tại UC Berkeley vào ngày 22 tháng 8 năm 2018, chứng minh cách một máy tính có thể xếp chồng một “bộ xương kỹ thuật số” lên hình dạng của một con người để khiến người đó trông giống như một vũ công giỏi. Nghe có vẻ vui đúng không?

Ai trong số chúng ta với hai bàn chân trái lại không muốn trình chiếu một video quay cảnh mình đang nhảy như Michael Jackson tiếp theo? Tuy nhiên, việc chúng tôi kết hợp trí tuệ nhân tạo với phần mềm chỉnh sửa và kết xuất video có thể có một số tác động xấu nếu công nghệ này bị lạm dụng.

Giới thiệu công việc của các nhà nghiên cứu

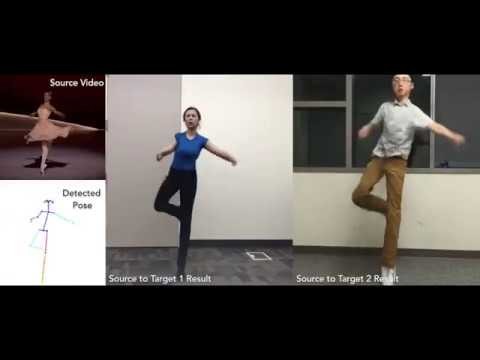

Bài báo được xuất bản bởi các nhà nghiên cứu đã được đề cập trước đó về cơ bản là một minh chứng về cách máy học có thể được sử dụng để “chuyển chuyển động giữa các đối tượng là con người trong các video khác nhau”, chồng các chuyển động của người này lên người khác một cách hiệu quả. Bạn có thể xem kết quả làm việc của họ tại đây:

Nó trông có vẻ buồn cười và hơi buồn cười, nhưng những thực tế mà chúng ta có thể phải đối mặt khi một công nghệ tiếp tục phát triển như vậy có thể là thách thức đối với chúng ta với tư cách là một xã hội trong tương lai. Mặc dù chúng ta đang sử dụng thuật ngữ “AI” một cách lỏng lẻo khi nói rằng đây là một minh chứng của kỹ thuật chỉnh sửa video thực hiện khái niệm này, nhưng chắc chắn nó là một trong những tiền thân của trí tuệ nhân tạo (ví dụ:“tưởng tượng” một người nào đó trong một tình huống) .

Hãy nói về Deepfakes

Sử dụng “deepfake” làm cụm từ tìm kiếm trên YouTube và bạn sẽ tìm thấy nhiều video thân thiện với công việc trình bày các hình ảnh hoán đổi khuôn mặt của những người nổi tiếng và một số nội dung sai lệch bán thuyết phục được tạo ra ngay tại chỗ. Mặc dù điều này thường được thực hiện với mục đích hài hước, nhưng không phải ai cũng có ý định tốt với phần mềm này.

Deepfakes lấy một cấu hình khuôn mặt của một cá nhân và siêu áp đặt nó lên khuôn mặt của một cá nhân khác. Bạn có thể thấy chúng tôi đang đi đâu với điều này, và nếu bạn không thể, thì đây:Có nhiều người sử dụng kỹ thuật này để tạo video "khiêu dâm trả thù" người khác, khiến họ rơi vào tình huống rất đáng sợ. tìm thấy sự đáng yêu của họ gắn liền với nội dung rõ ràng và không có quyền truy đòi. Có vẻ như họ đã làm bất cứ điều gì diễn ra trong video.

Một công nghệ lớp phủ tiên tiến hơn có thể cho phép máy tính vẽ một bộ xương ảo, sau đó cho phép các tác nhân độc hại chồng toàn bộ con người vào một tình huống có khả năng bị tổn hại. Những gì chúng ta có được là một loạt các công cụ có thể được sử dụng để ngụy tạo bằng chứng. Một người bắn súng có thể được tạo ra để trông giống một người khác trong cảnh quay hiện trường vụ án.

Điều này sẽ có tác dụng gì về mặt pháp lý?

Hầu hết các quốc gia đã có sẵn một hệ thống pháp luật xác định rõ ràng việc ngụy tạo các sự kiện hoặc một nhân chứng giả. Liên quan đến "mạo danh ảo" của một cá nhân, việc sử dụng các kỹ thuật này để sửa đổi video đã thuộc phạm vi điều chỉnh của các luật này.

Nơi mà mọi thứ trở nên phức tạp là khi tòa án thừa nhận bằng chứng video. Nếu chúng ta có công nghệ để quay video bác sĩ ở mức độ mà chúng ta làm ngay bây giờ, hãy tưởng tượng những gì chúng ta có thể làm trong thời gian 5 năm nữa. Làm cách nào để tòa án có thể coi video được gửi là đáng tin cậy? Không khó để thực hiện một bản sao giống hệt như một bản gốc. Xét cho cùng, tất cả đều là kỹ thuật số.

Các tòa án đã rất miễn cưỡng chấp nhận bằng chứng video vào hồ sơ vụ án của họ. Sự tiến bộ của công nghệ này thực sự có thể đẩy họ vượt quá giới hạn, đến mức họ không thể tin tưởng bất cứ điều gì được ghi lại trên video vì sợ chấp nhận điều gì đó đã được thuyết phục.

Cuối cùng, cho dù chúng ta muốn hay không, thì có vẻ như loại công nghệ mới này sẽ ở lại với chúng ta và chúng ta sẽ phải thích ứng cho phù hợp. Một trong những bước đầu tiên chúng tôi có thể thực hiện là nâng cao nhận thức về thực tế rằng video có thể bị làm giả dễ dàng hơn nhiều - và với ít yêu cầu về tài nguyên và kỹ năng hơn nhiều - so với những năm 80 trước đây. Cuối cùng, mọi người sẽ nghi ngờ hơn về các video họ xem.

“Công nghệ ngày càng trở nên tiên tiến hơn… Mọi người sẽ sợ hãi. Và tôi thực sự thông cảm với họ. Nhưng vì công nghệ không thể không được phát minh, chúng tôi phải phát triển cùng với nó. Tôi là người đề xuất bản thân thuật toán deepfakes và tiềm năng của nó hơn là những gì nó hiện đang được sử dụng. Nhưng một lần nữa, chào mừng bạn đến với Internet. ”

Đây là những gì một người dùng Reddit cụ thể đã nói với The Verge trong một bài báo được xuất bản vào tháng 2 năm 2018.

Bạn nghĩ chúng ta nên truyền bá nhận thức như thế nào? Chúng ta nên làm gì khác để thích ứng? Hãy thảo luận điều này trong phần bình luận!